Wat is de impact van deepfake op online vertrouwen?

Wat is deepfake en wat kunnen we er tegen doen?

Deepfake en de ontwikkeling ervan is steeds vaker in het nieuws. De nepvideo’s worden steeds beter en zijn met het blote oog niet meer van echt te onderscheiden. Omdat deepfake technologie steeds toegankelijker en beter wordt, maken cybercriminelen er steeds meer gebruik van. Wat is de impact van Deepfake op fraude en ons online vertrouwen? En wat kunnen we er tegen doen om online identiteitsfraude te voorkomen?

Liever luisteren? Luister naar onze podcast over Deepfake!

Wat is een Deepfake?

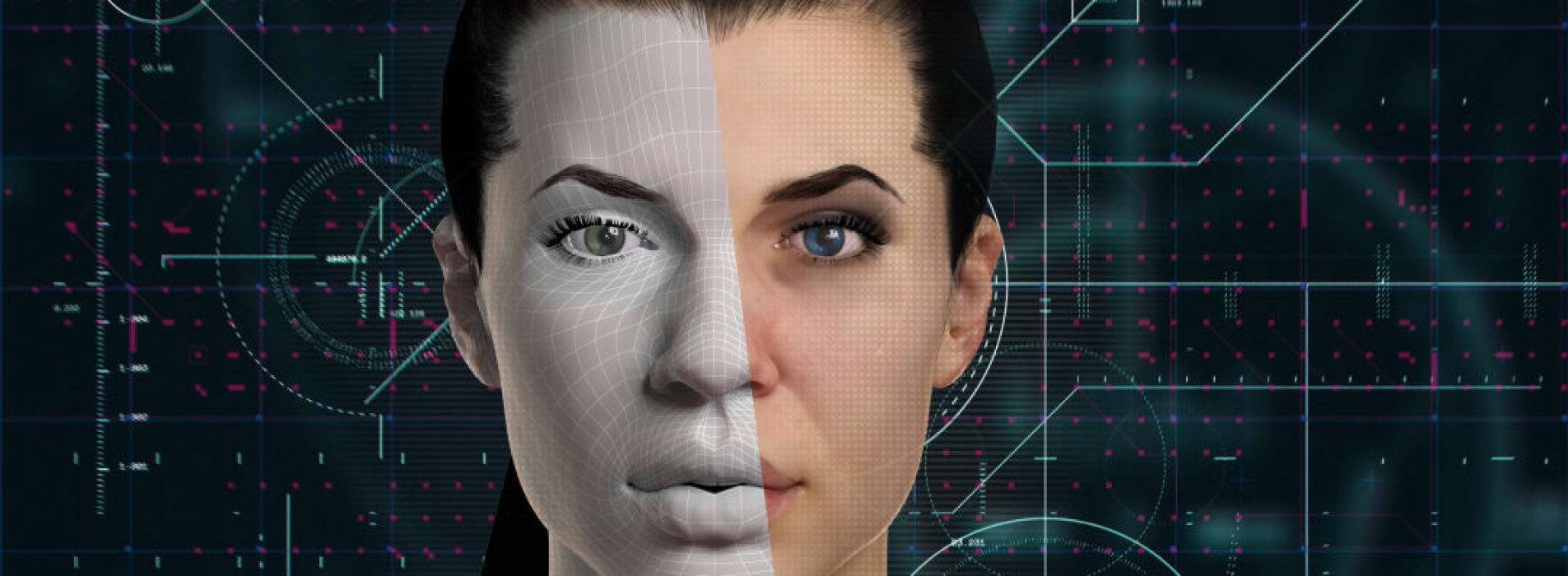

'Deep' staat voor deep learning en 'fake' voor het feit dat de video of audio nep is. Onder deep learning verstaan we een techniek die valt onder kunstmatige intelligentie (AI). Computers analyseren meerdere lagen in een beeld en leren hoe een gezicht wordt gemaakt. Van foto’s is algemeen bekend dat ze eenvoudig te manipuleren zijn. Voor bewegend beeld was dat altijd lastiger. Toch is het dankzij de deep learning tegenwoordig relatief eenvoudig om iemands hoofd op een ander persoon te monteren, zelfs met beweging. Je kent apps zoals Faceswap en Wombo waarschijnlijk wel. Leuk om een grappig filmpje mee te maken, maar de techniek wordt niet alleen voor onschuldige doeleinden gebruikt.

Naast het manipuleren van bestaande video’s, is AI ook in staat om compleet nieuwe personen te genereren. Dit type deepfake heet syntetische deepfakes of StyleGAN. Een voorbeeld daarvan is de website ‘This person does not exist’. Op de pagina zie je een foto van iemand die niet bestaat, maar compleet is gegenereerd door AI. Elke keer als je de pagina ververst zie je een nieuwe foto.

Deze persoon bestaat niet echt. Het gezicht is met behulp van AI gemaakt.

Hoe herken je een Deepfake?

Het wordt steeds moeilijker om een deepfake te herkennen, want de technologie blijft zich doorontwikkelen. Deepfakes van een lagere kwaliteit zijn nog steeds door mensen te herkennen. De lip-sync is bijvoorbeeld slechter, of de huidskleur is ongelijk. Andere elementen die slechte deepfakes niet goed kunnen creëren zijn haren, sieraden of tanden. Een deepfake van goede kwaliteit kan al deze elementen tegenwoordig al levensecht namaken. Maar als onze ogen tekort schieten, hoe kunnen we dan nog een deepfake herkennen?

Bedrijven zoals DuckDuckGoose gebruiken technologie om deepfakes te herkennen, de zogenaamde Deepdetector. Maar hoe werkt dat? Parya Lotfi, medeoprichter van DuckDuckGoose, legt dat uit.

Parya Lotfi: ‘DeepDetector is een neuraal netwerk dat in staat is deepfake gezichten - zowel gemanipuleerd als gegenereerd door een AI - in een video of in een afbeelding te onderscheiden van authentieke gezichten.”

Worden deepfakes gebruikt voor fraude?

Bijna iedereen heeft tegenwoordig een digitale voetprint. We plaatsen foto’s op Google, selfies op Instagram, profielfoto’s op LinkedIn, familiefoto’s op Facebook, enzovoorts. Al deze foto’s zijn potentiële input voor fraudeurs om overtuigende deepfakes mee te maken.

Tot nu toe werden deepfakes vooral gebruikt voor het imiteren van beroemdheden, politieke trucs en wraakpornografie. Maar criminelen hebben de mogelijkheden van deepfake ook ontdekt. Zo lukte het Chinese criminelen om het belastingsysteem te hacken met behulp van deepfake technologie. Door synthetische beelden te creëren konden ze nep bedrijven oprichten die vervolgens belastingfraude pleegden voor meer dan 75 miljoen Amerikaanse Dollars.

Ook met audio deepfakes hebben criminelen een effectieve manier gevonden om bedrijven op te lichten. In een rapport van The Wall Street Journal geloofde de CEO van een energiebedrijf dat hij aan de telefoon was met zijn baas, toen hij de orders van de andere kant van de telefoon opvolgde om onmiddellijk € 220.000 over te maken naar de bankrekening van een Hongaarse leverancier. De audio aan de telefoon was eigenlijk een audio-deepfake die de fraudeurs hadden gemaakt.

Naast deze voorbeelden ziet DataChecker dat dit soort nieuwe technologieën ook steeds vaker worden ingezet bij identiteitsdiefstal. Denk aan het openen van frauduleuze accounts en het overnemen van accounts.

- Fraude bij het openen van een nieuwe bankrekening: een fraudeur kan op een sociaal netwerk kijken en honderden afbeeldingen verzamelen van een persoon. De AI legt al deze afbeeldingen of audio fragmenten over elkaar en creëert zo een syntetische identiteit (een samensmelting van gestolen identiteitsinformatie). Als het goed genoeg is, kan de fraudeur deze identiteit bijvoorbeeld gebruiken om een nieuwe rekening bij de bank te openen en honderdduizenden euro’s aan leningen af te sluiten.

- Deepfakes gebruikt voor fraude met accountovername: tegenwoordig kunnen deepfakes worden gemaakt om biometrische gegevens na te bootsen en kunnen ze systemen die afhankelijk zijn van gezichts-, of stemherkenning misleiden om ze te ontgrendelen. Als een willekeurig persoon je om geld vraagt, ga je het niet meteen naar hem overmaken. Maar als een account van een van je vrienden is overgenomen door een Deepfake, zou je het bedrag sneller naar diegene kunnen overmaken. Een bekend voorbeeld hiervan is de Whatsapp fraude die steeds vaker voorkomt.

Komt er een tijd dat we Deepfakes niet meer kunnen herkennen?

Het detecteren van deepfakes wordt een steeds groter probleem. Binnenkort zullen we op technologie als DeepDetector moeten vertrouwen. Maar blijven die DeepDetectors de nieuwste vormen van deepfakes wel herkennen? Of blijven we met detectie technologie altijd achter de fraudeurs aanlopen?

Parya Lotfi: ‘Uit onderzoek blijkt dat algoritmes significant beter presteren op het moment dat menselijke ogen realistische deepfakes niet kunnen onderscheiden van het echt. Met andere woorden: deepfake detectie algoritmes kunnen afhankelijk van de gebruikte training datasets op een nauwkeurige wijze deepfake beelden detecteren die niet te onderscheiden zijn voor mensen.

Deepfake detectie algoritmes kunnen tevens zodanig ontwikkeld worden dat deze een algemene benadering aannemen om meerdere soorten deepfakes te detecteren, inclusief deepfakes van onbekende generatiemethoden. Zo hebben onderzoekers recent een Convolutional LSTM-based Residual Network ontwikkeld, dat een nieuwe strategie hanteert voor het trainen van het deepfake detectie model door zowel spatial als temporal informatie in deepfakes te onderzoeken. Dit zorgt ervoor dat een dergelijk neuraal netwerk beter kan omgaan met onbekende en/of nieuwe vormen van deepfakes. Dus het lijkt erop dat technologische ontwikkelingen mogelijk een einde kunnen maken aan het kat en muis spel tussen fraudeurs en developers van detectie technologie.’

Wat zijn de gevolgen van Deepfakes voor online verificatie?

Deepfakes hebben ook grote gevolgen voor het online identificeren van mensen. Een online identificatieproces gebruikt foto’s of bewegende beelden. Bij die beelden kunnen in theorie deepfakes worden gebruikt.

Liveness detectie

Om deze dreiging tegen te gaan, is het belangrijk ervoor te zorgen dat identificatiesoftware, gecertificeerde ‘liveness’ detectie bevat. Zo laat DataChecker op dit moment tijdens het identificatieproces, met behulp van de ID-selfie, mensen glimlachen om zeker te weten dat we te maken hebben met een echt persoon. Maar geavanceerde deepfakes kunnen veelvoorkomende bewegingen zoals knipperen en zelfs in extreme gevallen glimlachen al nabootsen. Dus hoe lossen we dit probleem op? Er is niet één oplossing voor deze uitdaging. Meerdere lagen van veiligheid zijn het antwoord op de vraag.

Multi-factor Authenticatie

De combinatie van de verificatie van identiteitsdocumenten met de identificatie van een persoon is een vorm van multi-factor authenticatie. De fraudeur heeft naast geavanceerde deepfake technologie dan ook een geldig identiteitsdocument nodig. Dit kan voor processen met hoge risico’s bijvoorbeeld nog worden gecombineerd met een confirmatie via een ander kanaal zoals mail of SMS. Hoe meer stappen er nodig zijn in een proces, hoe lastiger het wordt voor een fraudeur om deze stappen te doorlopen. DataChecker helpt bedrijven vinden met de balans van veiligheid en gebruiksvriendelijkheid, want meer stappen kan leiden tot meer uitval als de user experience niet optimaal is.

Reverificatie

Een andere effectieve manier om fraude tegen te gaan is reverificatie. Het woord zegt het al een beetje, reverificatie is het opnieuw verifiëren van een account. Je hebt bij een organisatie een identificatieproces doorlopen, maar wordt op bepaalde momenten gevraagd om dit nogmaals te doen. Dit kan bijvoorbeeld bij transacties met hoge bedragen of als er plotseling veel activiteit ontstaat bij een account dat lange tijd inactief is geweest.

Geïntegreerde DeepDetector

DeepDetectors zijn een belangrijke manier om deepfakes te herkennen. Deze DeepDetectors zullen in de toekomst steeds belangrijker worden om het identificatieproces veilig te houden. Software helpt om gemanipuleerde beelden tijdig te onderscheppen. Het verificatieproces van DataChecker wordt geïntegreerd met de software van bedrijven als Duckduckgoose om de veiligheid voor gebruikers te waarborgen en fraude te minimaliseren.